(사진=AFP)

엑스 사용자들 사이에 이 같은 사실이 알려지면서 딥페이크 피해도 확산 중이다. 로이터는 지난 2일 정오 단 10분 동안 100건이 넘는 ‘디지털 탈의’ 요청이 올라온 것을 확인했다. 대상의 대부분은 젊은 여성이었으며, 일부 남성, 유명인, 정치인, 그리고 한 사례에서는 원숭이도 포함됐다.

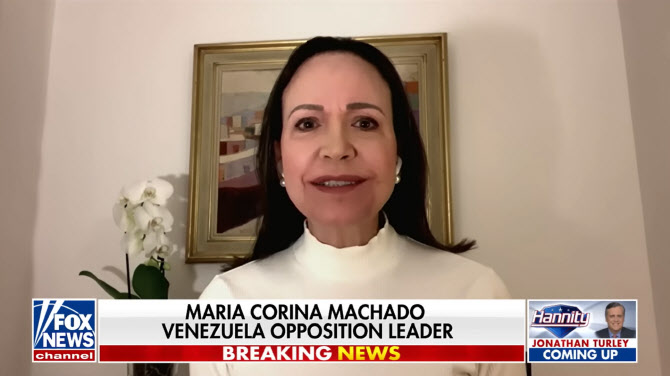

브라질 리우데자네이루에 거주하는 음악가 줄리 유카리는 새해 전야 자정 직전, 약혼자가 찍어준 사진 한 장을 엑스에 올렸다가 피해를 봤다. 다음날 사용자들이 그록에게 자신의 사진을 비키니 차림으로 바꿔 달라는 요청을하고 있다는 알림을 발견했을 땐 이미 나체에 가까운 딥페이크 이미지가 퍼지기 시작한 후였다. 로이터는 “유카리의 경험은 엑스 플랫폼 전반에서 반복되고 있다”며 “그록이 아동의 성적 이미지를 생성한 사례도 여러 건 확인했다”고 전했다.

전문가들은 그록이 딥페이크 성착취 이미지를 만들고 확산하는 진입 장벽을 크게 낮추고 있다고 지적한다. 유사한 AI 프로그램인 이른바 ‘누디파이어(nudifiers)’는 수년 전부터 존재해 왔지만, 그동안은 특정 웹사이트나 텔레그램 채널 등 인터넷의 음지에 국한돼 있었고, 일정한 노력이나 비용이 필요했다. 하지만 엑스에서는 사진을 올리고 그록을 태그해 명령만 내리면 딥페이크 생성가능하고 그렇게 만들어진 이미지가 엑스를 통해 널리 퍼지게 됐다는 지적이다.

전문가 3명은 로이터에 “그록 개발사 xAI가 시민사회와 아동 안전 단체들의 경고를 무시해 왔다”며 “지난해 xAI에 ‘명백히 비동의 딥페이크의 홍수’가 일어날 것이라고 경고한 서한을 보내기도 했다”고 지적했다.

미국 국립 성착취 방지센터 산하 법률센터 최고법률책임자(CLO) 대니 핀터는 “엑스는 AI 학습 데이터에서 학대적 이미지를 제거하지 않았고, 불법 콘텐츠를 요청하는 이용자들의 행위를 차단하지도 않았다”며 “이번 사태는 완전히 예견 가능했고 피할 수 있었다”고 꼬집었다.

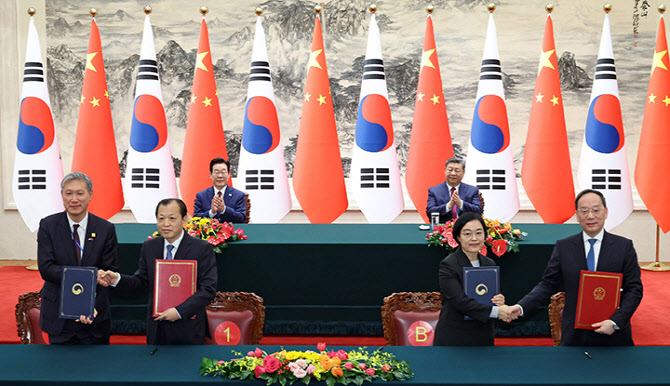

이번 사안은 국제적인 비판을 받고 있다. 프랑스 정부는 3일 그록이 생성한 성적 이미지를 검찰에 신고했다. 또 유럽연합(EU)의 디지털서비스법(DSA)상 엑스의 의무 위반 가능성을 조사해 달라고 프랑스 미디어 규제당국 아르콤에 요청했다.

프랑스 재무부는 성명을 통해 “프랑스는 이러한 행위를 가장 강력한 표현으로 규탄하며, 모든 형태의 성폭력과 젠더 기반 폭력에 맞서 싸우겠다는 정부의 확고한 의지를 재확인한다”고 밝혔다.

인도 정부도 엑스의 현지 법인에 서한을 보내 “그록이 음란하고 노골적인 성적 콘텐츠를 생성·유포하는 것을 막지 못했다”고 지적했다.