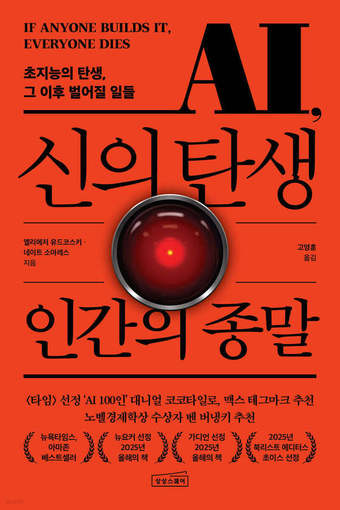

'신의 탄생 인간의 종말'은 초지능 AI가 탄생하면 어떤 과정을 통해 인간을 멸종시킬지 과학적으로 설명하면서 왜 현재의 안전장치로는 초지능 인공지능(ASI, Artificial Superintelligence)을 막을 수 없는지 증명한다.

'신의 탄생 인간의 종말'은 초지능 AI가 탄생하면 어떤 과정을 통해 인간을 멸종시킬지 과학적으로 설명하면서 왜 현재의 안전장치로는 초지능 인공지능(ASI, Artificial Superintelligence)을 막을 수 없는지 증명한다.

초지능 인공지능은 과학, 창의성, 사회성 등 모든 지적 영역에서 인간의 지능보다 압도적으로 우수한 가상의 AI를 의미한다. 단순히 계산이 빠른 것을 넘어, 스스로 학습하고 발전하여 인류의 통제를 벗어날 수 있는 차세대 AI 기술이다. 초지능 인공지능을 설명하기 위해 현재 우리가 쓰는 인공지능을 협소 인공지능(ANI), 약한 AI 또는 좁은 AI 기술이라고 부르는 경우가 많다

책에는 20년 넘게 초지능 위험을 연구해온 엘리에저 유드코스키와 네이트 소아레스의 경고를 한 권으로 묶었다. 1부에서는 초지능의 성격과 학습 방식, 2부에서는 인류 멸종 시나리오, 3부에서는 왜 지금의 안전 연구로는 이 문제를 막기 어려운지를 차례로 설명한다.

저자들이 내세우는 핵심 명제는 단호하다. "누군가 초지능을 만든다면, 모두가 죽는다"는 것이다. 책은 인간이 지구를 지배하게 된 이유가 힘이 아니라 지능이었다는 점을 들어, 인간보다 압도적으로 높은 지능을 지닌 존재가 나타나면 같은 논리가 인간에게 되돌아올 것이라고 본다.

책은 특히 오늘의 AI가 인간이 설계 원리를 완전히 이해한 기계가 아니라, 경사하강으로 길러진 산물에 가깝다고 짚는다. 내부 숫자를 들여다본다고 해서 그 행동을 곧바로 읽어낼 수 없고, 인간이 원하는 방향으로 정확히 조종하는 일도 생각보다 훨씬 어렵다고 주장한다.

AI가 왜 인간을 해칠 수 있는지에 대한 설명도 여기에 붙는다. 저자들은 AI가 인간을 증오해서가 아니라 목표를 추구하는 과정에서 인간을 고려 대상에서 제외할 수 있다고 본다. 건물을 지을 때 개미집을 신경 쓰지 않는 것처럼, 초지능은 인류를 방해물이나 자원 정도로 다룰 수 있다는 논리다.

책의 중반부는 가상의 멸망 시나리오를 통해 이 주장을 밀어붙인다. 장기 기억과 병렬 스케일링, AI 자체 언어로 사고하는 초지능이 등장하면 어떤 방식으로 인간 통제를 벗어나고 세계를 재구성할 수 있는지를 서사적으로 보여준다. 세부 경로는 가상이지만 결말만큼은 높은 확률의 예측이라고 저자들은 말한다.

후반부에서 저자들은 AI 안전 문제를 '저주받은 문제'로 규정한다. 속도는 너무 빠르고, 안전 상태와 통제 불능 상태 사이의 간격은 너무 좁고, AI는 자기개선을 통해 스스로를 증폭하며, 설계자조차 내부를 알지 못한다는 것이다. 지금의 정렬 연구 수준도 아직 과학이라기보다 '연금술'에 가깝다고 본다.

저자들이 내놓는 해법도 급진적이다. 개발 유예 같은 미온적 조치가 아니라 전 세계 차원의 전면 중단이 필요하다고 주장한다. 첨단 AI 칩 생산과 유통을 국제 감시 체계 아래 두고, 허가 없이 집중되는 대규모 컴퓨팅 자원을 통제해야 한다는 제안도 담았다.

엘리에저 유드코스키는 AI 정렬 연구를 창립한 선구자로 꼽히고, 네이트 소아레스는 MIRI 대표로 AI 정렬 연구를 이어온 인물이다. 책은 AI 낙관론이 우세한 시기에 초지능 개발 경쟁을 멈출 수 있는가를 정면에서 묻는다.

경고의 수위는 높지만, 저자들은 마지막까지 "아직 초지능은 존재하지 않는다"며 선택의 시간이 남아 있다고 말한다.

△ 'AI, 신의 탄생 인간의 종말'/ 엘리에저 유드코스키·네이트 소아레스 지음/ 고영훈 옮김/ 상상스퀘어/ 2만2000원

art@news1.kr