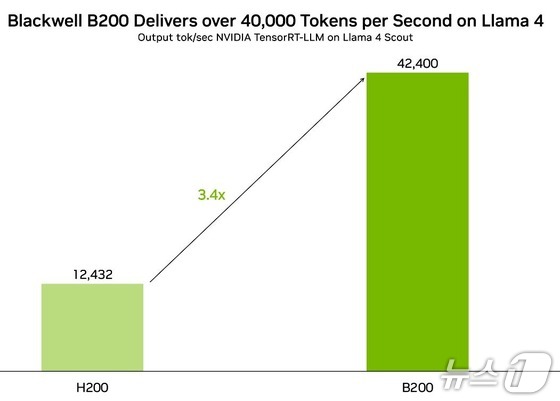

메타 라마-스카우트 모델의 블랙웰B200 GPU·TensorRT-LLM 활용시 초당 처리 토큰 수 향상 수준(엔비디아 홈페이지 갈무리)

알리바바·바이두 등 중국 기업들에 이어 네이버(035420)와 LG(003550)도 정상급 AI 모델을 공개하며 주도권 경쟁에 뛰어들었다.

25일 IT 업계·외신에 따르면 엔비디아는 이달 18일(현지시간) 메타 라마4-스카우트(Scout)와 라마4-매버릭(Maverick)의 추론을 가속하는 오픈소스 기술을 발표했다.

라마4 시리즈는 메타가 처음으로 전문가혼합(Mixture of Experts·MoE) 아키텍처를 적용한 최신 모델이다. 엔비디아는 두 모델을 'TensorRT-LLM'에 최적화하고 블랙웰 FP4 텐서코어 성능을 더해 초당 토큰 처리 속도를 높였다.

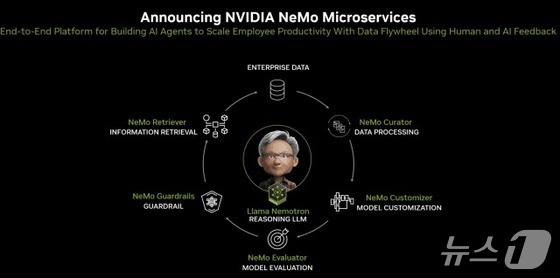

엔비디아 AI 에이전트 구축 플랫폼 니모 마이크로서비스(엔비디아 제공)

최적화된 라마4-스카우트는 초당 4만 토큰 이상, 라마4-매버릭은 초당 3만 토큰 이상의 처리 속도를 기록했다. 이용자는 AI 에이전트 구축 플랫폼 '니모 마이크로서비스'에서 이를 활용할 수 있다.

엔비디아 측은 "메타는 오픈 모델 생태계를 함께 키워온 오랜 파트너"라며 "이용자들이 더 효율적으로 일하고 복잡한 과제를 해결할 수 있도록 지원하기 위해 성능은 높이고 비용은 줄이는 데 힘쓰고 있다"고 말했다.

구글 딥마인드 제미나이 2.5 프로 익스페리멘털(구글 X 갈무리)

구글 딥마인드는 지난달 복잡한 문제 해결에 특화한 추론형 사고 모델 '제미나이 2.5 프로 익스페리멘털'을 출시했다.

오픈AI o3 이미지(샘 올트먼 오픈AI CEO X 갈무리)

오픈AI도 최근 이미지 기반 추론 모델인 'o3'와 'o4-미니'를 공개했다. 두 모델은 이용자가 PDF·다이어그램·화이트보드 스케치 등의 이미지를 업로드하면 AI가 시각 정보를 통합 추론하는 방식으로 답변한다. 오픈AI는 'GPT-4.1'과 'GPT-4.1 미니' 'GPT-4.1 나노' 등도 개발자용으로 공개했다.

네이버가 선보일 추론형 AI 모델 ⓒ 뉴스1

업계는 하드웨어·소프트웨어 통합 최적화가 추론형 AI 모델의 핵심 경쟁력으로 부상하고 있다고 분석했다.

한국 기업들도 추론형 AI 모델 개발에 박차를 가하고 있다.

네이버는 경량 모델 'HyperCLOVAXSEED' 시리즈 3종(3B·1.5B·0.5B) 오픈소스로 공개했다. 추론형 모델도 다음 달 공개할 계획이다.

LG는 지난달 추론형 거대언어모델(LLM) AI '엑사원 딥-32B'과 소형모델 '엑사원 딥-7.8B' 온디바이스 초소형모델 '엑사원 딥-2.4B' 등을 오픈소스로 공개했다.

LG 관계자는 "동급 모델 기준 오픈AI 모델 및 중국 딥시크 등보다 성능이 우월하다"고 말했다.

ideaed@news1.kr