반면 중국은 오픈 웨이트(가중치 공개) 모델을 전면에 내세워 개발자 생태계를 끌어들이는 데 공을 들인다. 한국은 정부 주도의 ‘독자 AI 파운데이션 모델’ 프로젝트를 추진 중이지만, 글로벌 오픈소스·오픈 웨이트를 참고할 가능성이 큰 만큼 쟁점은 ‘사용 여부’가 아니다. 무엇을 썼는지, 라이선스를 어떻게 관리하는지, 문제 발생 시 즉시 수정·대응할 통제 역량을 갖췄는지가 더 큰 과제로 떠오르고 있다.

[이데일리 이미나 기자]

오픈소스는 원래 소스코드를 공개해 누구나 사용·수정·재배포할 수 있도록 하는 개발 방식이자 라이선스 체계를 뜻한다. 하지만 AI로 오면 경계가 복잡해진다. 모델은 코드(학습·추론 소프트웨어), 가중치(학습 결과물), 데이터(학습 자료)로 구성되는데, 무엇을 공개하느냐에 따라 권리와 책임의 범위가 달라진다. 이 때문에 업계에서는 ‘오픈소스’와 구분해 ‘오픈 웨이트’라는 표현을 쓴다. 가중치를 공개해 외부에서 실행·검증·개조가 가능하더라도, 학습 데이터나 학습 과정, 운영 노하우는 공개되지 않을 수 있고 이용 조건은 라이선스가 좌우하기 때문이다.

미국, “연구는 개방·코어는 통제”

미국 빅테크의 기본 방향은 “개방은 확산을 위해, 통제는 경쟁력과 책임을 위해”로 요약된다. 오픈AI가 오픈 웨이트 모델을 별도 라인업으로 공개하더라도, 주력 상용 모델은 응용프로그램인터페이스(API)기반으로 관리하는 방식이다. 이를테면 오픈AI는 ‘오픈 웨이트’ 모델인 gpt-oss-120b, gpt-oss-20b를 공개했지만, GPT-5.2는 별개 라인업으로 두고 있다.

공개 범위를 조절해 생태계의 혁신 속도는 흡수하되, 상업 경쟁에서의 차별화와 악용 위험, 규제·소송 리스크는 내부에서 관리하겠다는 계산이 깔려 있다는 해석이다. 다만 ‘오픈’의 경계는 더 논쟁적이 됐다. 메타 라마(Llama)처럼 ‘오픈’ 간판을 내걸었지만 제한 조항을 두면서 “오픈소스라 부를 수 있느냐”는 분류 논쟁이 계속되는 점이 이를 보여준다.

중국, 오픈 웨이트로 확산…핵심은 내부에

중국은 오픈 웨이트를 앞세워 개발자 풀을 빠르게 넓히는 전략을 취하고 있다는 평가가 많다. 알리바바의 큐웬(Qwen) 계열처럼 깃허브·허깅페이스 등에서 접근성을 높인 사례가 대표적으로 거론된다. 다만 오픈 웨이트 확산이 곧 ‘완전한 투명성’을 의미하는 것은 아니라는 반론도 있다. 학습 데이터, 학습 방법, 서비스 운영 노하우 같은 핵심 요소는 공개 범위 밖에 남는 경우가 많아 “오픈처럼 보이되, 장악은 내부에 두는 방식”이라는 평가다.

[이데일리 김정훈 기자]

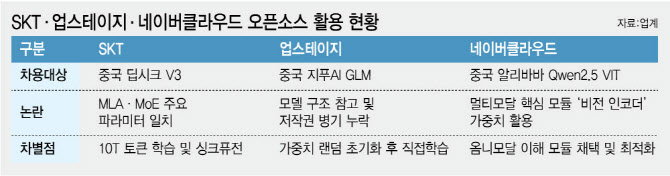

‘국가대표 AI’로 거론되는 LG AI연구원(K-EXAONE), SK텔레콤(A.X K1), 네이버클라우드(HyperCLOVA X), 업스테이지(SOLAR), NC AI(VAETKI) 역시 ‘완전 신설계’라기보다 공개 연구 성과를 바탕으로 구조를 조합하고 성능을 끌어올린 형태로 평가된다.

MoE(Mixture of Experts)처럼 여러 ‘전문가’를 선택해 계산하는 구조에서 기본 설정이 닮아 있는 반면, 전문가 쏠림을 막는 로드 밸런싱(보조 손실) 적용 방식, 문맥을 처리하는 어텐션 구조(MLA·GQA·혼합형), 전문가 반영 강도(routed scaling) 같은 세부 파라미터에서 차별화가 나타난다는 식이다. 결국 같은 뼈대 위에서 튜닝과 운영 노하우가 실질 경쟁력으로 부상하는 구조다.

반면, 메타나 미스트랄, 딥시크 같은 선발 글로벌 AI 기어들은 “왜 이 모델이 세상에 필요한가”에 대한 철학적 해답을 수식으로 증명해냈다는 점에서, 대한민국 AI의 갈 길이 아직은 멀다는 평가도 나온다.

이를테면 딥시크는 자본의 취약점을 수학적 천재성으로 극복했다. 문맥 정보를 잠재 공간에 압축해 메모리 부담을 낮춘 MLA(Multi-head Latent Attention) 기술로 글로벌 AI판도를 뒤흔들었고, 알리바바 큐웬(Qwen)는 모든 언어와 코드를 가장 효율적으로 처리하기 위해 15만 개 이상의 거대 어휘집(Tokenizer)을 수학적으로 최적화했다. 최근에는 인간의 사고 과정을 모사하는 시스템-2 수식 설계를 통해 추론 모델 QwQ로 진화하고 있다.

오픈소스 논쟁의 본질은 ‘카피’ 아닌 통제력

국가대표 AI들이 오픈소스를 활용하는 만큼 유사성 논란이 뒤따르는 것은 불가피하다. 해외에서도 딥시크가 2025년 1월 기존 모델 출력물을 학습해 결과를 내놓는 방식인 ‘증류(distillation)’를 택했을 가능성이 제기되며 논쟁이 커졌고, 오픈AI가 관련 의혹을 검토한다고 밝힌 바 있다.

이 같은 논쟁이 반복될수록 초점은 “오픈소스를 썼느냐”가 아니라 “무엇을, 왜, 어떻게 썼는가”로 이동한다. 어떤 구성요소를 선택했고(비용·기간·성능 목표), 적용 과정에서 무엇을 얼마나 바꿨는지(개선 범위·재현 가능성), 이를 어떻게 설명·검증할지, 문제가 생기면 누가 어떤 권한과 인력으로 수정·대응할지까지가 핵심이라는 평가다.

이에 따라 ‘독자 AI 파운데이션 모델’의 평가는 “무엇을 통제할 수 있느냐”로 옮겨가고 있다. 라이선스·출처 표기 체계와 사전 문서화, 사후 대응 체계를 갖추라는 요구가 커지는 배경이다. 강상기 한양대 AI솔루션센터장도 “이론적 순결성보다 실용이 중요하며, 유사성 논란을 피하기보다 표기·설명·사후 대응 논리와 통제력을 갖추는 것이 핵심”이라고 강조했다.