오픈AI는 이번 계약이 과거 어떤 기밀 AI 배치 합의보다 강한 안전장치를 포함하며, “앤스로픽을 포함한 기존 합의보다 더 촘촘한 가드레일(AI를 쓰되, 위험선은 넘지 못하게 하는 기술·계약·운영상의 안전 울타리)”을 갖췄다고 주장했다.

오픈AI는 28일(현지시간) 자사 블로그에서 “펜타곤과 기밀 환경 배치에 합의했으며, 동일한 조건이 모든 AI 기업에도 제공되기를 요청했다”고 밝혔다. 정부와 AI 연구소 간의 “깊은 협력”이 필요하다는 점도 강조했다.

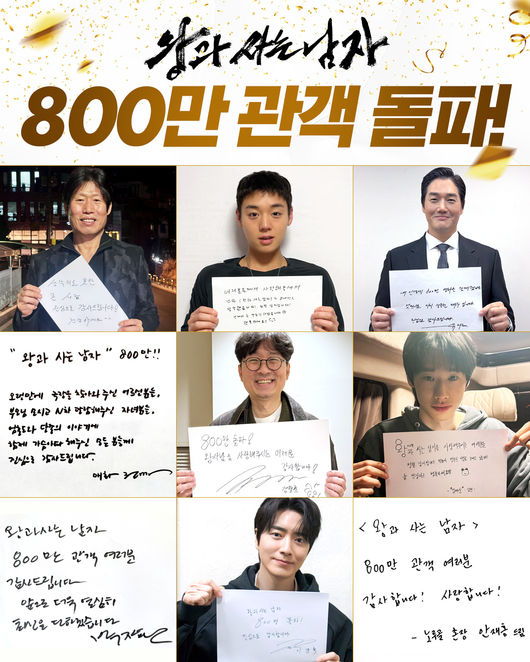

샘 올트먼 오픈AI CEO. 사진/로이터

오픈AI는 국방부 협력에서 세 가지 레드라인을 설정했다고 밝혔다.

대규모 국내 감시에 사용하지 않으며, 자율 무기 시스템을 독립적으로 지휘하는 데 활용하지 않고, 사회 신용 시스템 등 고위험 자동 의사결정에도 쓰지 않겠다는 내용이다.

이를 집행하기 위한 방식으로 오픈AI는 “클라우드 전용 배치”를 내세웠다. 엣지(현장 단말) 배치를 하지 않고, 안전 스택을 직접 운영·통제하며, 분류기를 통해 레드라인 위반 여부를 독립적으로 점검·업데이트할 수 있다는 설명이다.

보안 인가를 받은 오픈AI 엔지니어가 현장에 참여하고, 안전·정렬 연구진도 의사결정 과정에 관여하는 구조라고 밝혔다.

이는 오픈AI가 국방부와의 계약에서 자율 무기 통제 금지, 대규모 감시 금지, 고위험 자동 의사결정 배제, 클라우드 전용 배치(엣지 배치 차단), 보안 인가 인력의 상시 참여 등을 통해 자사 AI 기술이 위험선을 넘지 않도록 하겠다는 뜻이다.

◇계약 문구에 제한 명시…“앤스로픽보다 집행 가능”

오픈AI가 공개한 계약 조항에는 자율무기 및 감시 관련 제한이 구체적으로 담겼다고 밝혔다. 법·규정·정책이 인간 통제를 요구하는 경우 AI가 자율 무기를 독립적으로 지휘할 수 없고, 인간 승인이 필요한 고위험 결정도 자동 수행할 수 없다는 취지다.

또한 자율·반자율 시스템에서 AI를 활용할 경우 배치 전 엄격한 검증·검증·시험 절차를 거쳐야 한다는 국방부 지침을 계약에 반영했다고 설명했다.

정보 활동과 관련해서는 수정헌법 제4조, 해외정보감시법(FISA) 등 기존 법·지침을 준수해야 하며 미국 시민의 사적 정보에 대한 무제한 모니터링에는 사용할 수 없다는 제한도 포함됐다고 밝혔다.

오픈AI는 “앤스로픽이 왜 합의에 이르지 못했는지는 알 수 없다”면서도, 클라우드 전용 배치와 안전 스택 통제권, 보안 인력의 상시 참여가 “더 집행 가능한 구조”라고 주장했다.

다만, 앤스로픽을 ‘공급망 위험’으로 지정하는 데는 반대 입장도 정부에 전달했다고 덧붙였다.

◇“굴복” vs “현실적 승부수”…여론·정치권도 엇갈려

오픈AI와 미 국방부간 계약 공개 이후 반응은 갈렸다.

X·레딧 등에서는 ‘인간 통제’ ‘합법적 용도’ 같은 표현이 모호하다는 비판과 함께, 정부가 법·정책을 바꾸면 제한이 무력화될 수 있다는 우려가 나왔다.

“원칙을 지키다 퇴출된 앤스로픽과 달리 오픈AI는 굴복했다”는 반응도 확산되며 챗GPT 구독을 끊고 클로드로 옮기겠다는 글이 이어지기도 했다. 아울러 국방부와의 밀착이 사용자 데이터 감시로 이어질 수 있다는 의심도 함께 제기됐다.

반면 중국 등 경쟁국의 AI 군사화가 가속하는 상황에서 정부 협력은 불가피하며, 안전장치를 유지한 채 정부 시장을 선점한 “현실적 선택”이라는 옹호도 나왔다.

정치권 역시 트럼프 행정부·공화당의 환영 기류와, 민주당 일각의 “대규모 감시 우려”가 맞서며 논쟁이 이어지고 있다.