알리바바는 자연어 명령만으로 영상의 모든 요소를 수정할 수 있어, 개인 크리에이터도 전문 연출가 수준의 결과물을 얻을 수 있는 길이 열렸다고 강조했다.

Wan2.7-Video는 단순히 텍스트를 영상으로 바꾸는 데 그치지 않고 △텍스트 기반(t2v) △이미지 기반(i2v) △레퍼런스 기반(r2v) △영상 편집 전용(videoedit) 등 4개 모델을 하나의 시스템으로 통합했다. 이를 통해 영상의 생성과 편집, 복제, 재구성, 장면 이어가기 등 제작 전 과정을 유기적으로 연결한다.

가장 큰 특징은 서사적 일관성이다. 그동안 AI 영상의 고질적 문제였던 장면 간 불일치를 해소해, 스크립트 입력부터 이미지 제어까지 하나의 흐름으로 처리할 수 있다. 영상 길이는 2초에서 최대 15초까지 지원하며, 720p와 1080p 해상도를 제공한다. 기업 사용자를 위한 API도 함께 지원해 대량 작업도 가능하다.

후반 작업의 효율성도 대폭 강화됐다. 자연어로 캐릭터의 동작, 대사, 외형은 물론 촬영 방식까지 직접 수정할 수 있다. 특히 스크립트가 바뀌어도 인물의 입 모양과 음성을 자동으로 맞춰주는 ‘립싱크’ 기능을 지원하며, 최대 5명의 캐릭터까지 각기 다른 음성 톤과 시각적 정체성을 유지할 수 있다.

Wan2.7-Image로 생성한 이미지. (사진=알리바바)

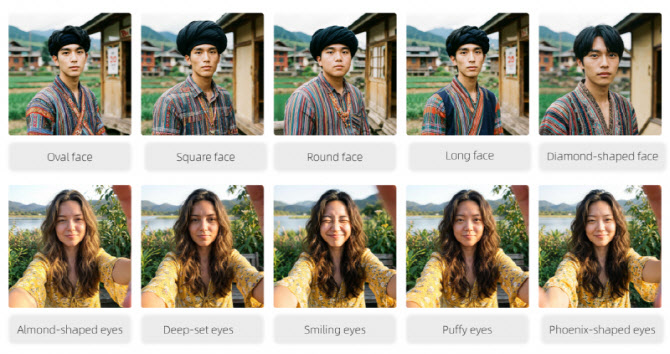

영상 모델에 앞서 공개된 ‘Wan2.7-Image’는 시각적 디테일과 개인화에 집중했다. 캐릭터의 골격이나 눈 모양 같은 세부 특성을 조정하는 개인화 엔진과, 색상 코드를 직접 입력해 브랜드 고유의 색을 구현하는 ‘컬러 팔레트’ 기능이 탑재됐다.

이 모델은 3000토큰 규모의 컨텍스트 처리 능력을 바탕으로 복잡한 수식이나 표가 포함된 학술 텍스트까지 인쇄 품질로 생성한다. 구성 안정성과 4K 고해상도를 지원하는 ‘Wan2.7-Image-Pro’ 버전도 함께 출시됐다.

이번에 공개된 모델들은 알리바바 클라우드의 ‘모델 스튜디오(Model Studio)’와 공식 웹사이트에서 이용할 수 있으며, 향후 알리바바의 AI 앱인 ‘큐원(Qwen)’에도 통합될 예정이다.