영국 정부 산하 AI안전연구소(AISI)는 지난 13일(현지시간) 공개한 연구 블로그에서 “AI 모델이 수행할 수 있는 자율적 사이버 공격 작업 수준이 2024년 말 이후 약 4.7개월마다 두 배씩 증가하고 있다”고 밝혔다. 이는 AISI가 지난해 11월 제시했던 ‘8개월마다 두 배 성장’ 전망보다 훨씬 빨라진 수치다.

[이데일리 김정훈 기자]

AISI는 이번 연구에서 앤스로픽의 ‘클로드 미토스 프리뷰’와 오픈AI의 ‘GPT-5.5’를 핵심 평가 대상으로 언급했다. 특히 AISI는 앤스로픽으로부터 클로드 미토스 프리뷰의 사전 배포(pre-deployment) 버전과 이후 개선된 체크포인트에 대한 접근 권한을 받아 직접 테스트를 수행했다고 밝혔다.

연구진은 “새롭게 제공받은 미토스 프리뷰 체크포인트는 이전 버전보다 향상된 사이버 보안 성능을 보였다”며 “처음으로 두 개의 사이버 레인지 과제를 모두 해결했다”고 설명했다.

클로드 미토스 프리뷰는 현재 일반 공개 모델이 아니라 일부 정부·연구기관·기업 파트너에 제한 제공되는 프리뷰 모델로 알려져 있다. AISI는 이 모델을 실제 평가 환경에서 테스트하며 자율 공격 능력을 분석했다.

◇“실제 해킹 수준 접근”…고난도 공격 시나리오 수행

AISI는 AI 모델의 사이버 공격 능력을 측정하기 위해 취약점 탐지, 리버스 엔지니어링, 웹 익스플로잇, 내부 네트워크 이동 등 실제 해킹과 유사한 환경을 구성했다.

특히 모의 기업 네트워크를 공격하는 ‘사이버 레인지’ 실험에서 클로드 미토스 프리뷰는 기존 AI 모델들이 해결하지 못했던 고난도 시나리오를 처음으로 성공적으로 완료했다. GPT-5.5 역시 일부 시나리오를 높은 성공률로 수행했다.

AISI는 “최신 모델들은 인간 전문가가 수십 분에서 수시간 걸리는 작업을 높은 성공률로 수행하고 있다”며 “일부 장시간 작업에서는 거의 완벽에 가까운 결과도 나타났다”고 밝혔다.

◇“AI 사이버 위협, 이미 현실화 단계”

다만 연구진은 이번 평가가 제한된 테스트 환경과 특정 작업군을 기반으로 한 것이라는 점도 함께 언급했다. AI의 실제 공격 역량 전체를 완벽히 측정하는 것은 아니며, 향후 발전 속도 역시 불확실성이 존재한다는 설명이다.

그럼에도 AISI는 AI 기반 사이버 공격 능력이 빠르게 현실화되고 있다는 점에 주목했다.

연구진은 “AI는 공격자와 방어자 모두를 강화할 수 있다”며 “강력한 AI 모델 접근이 시간이 갈수록 확산될 수 있는 만큼 지금이 보안 기반을 강화해야 할 시점”이라고 강조했다.

이어 “현재와 같은 발전 속도가 유지되거나 더 빨라질 경우 AI 사이버 역량은 끊임없이 변화하는 추격 대상이 될 것”이라며 “정부와 기업 모두 기존 보안 체계를 AI 시대에 맞게 재정비해야 한다”고 덧붙였다.

한편 지난 11일 류제명 과학기술정보통신부 차관이 방한한 마이클 셀리토 앤스로픽 글로벌 정책 총괄과 만나 AI 보안 협력 확대 방안을 논의하기도 했다.

이날 논의에서는 AI 방어 기술 관련 정보 공유 확대가 핵심 성과로 꼽혔다. 류제명 차관은 “AI안전연구소(AISI), KISA, 금융보안원 등 신뢰할 수 있는 국내 기관들에 대해 앤스로픽이 기존 기업 고객 수준보다 훨씬 깊이 있는 보안 데이터와 정보를 공유하기로 했다”고 설명했다.

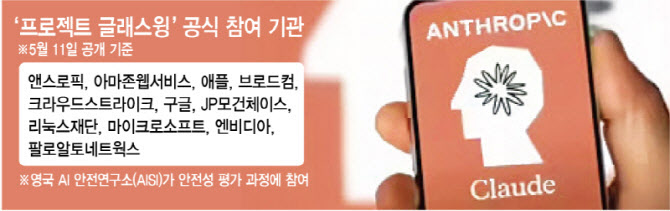

다만 ‘미토스 프리뷰’ 접근권을 보장받는 ‘프로젝트 글래스윙’ 참여 여부는 아직 조율 단계인 것으로 전해졌다. 앤스로픽 측은 한국 정부 요청을 거부했다기보다, 미토스급 AI 모델의 파급력이 큰 만큼 미국 정부와의 사전 협의가 필요하다는 입장을 전달한 것으로 알려졌다.

현재 프로젝트 글래스윙은 구글, 마이크로소프트 등 일부 핵심 파트너만 제한 참여하는 폐쇄형 구조로 운영되고 있다. 영국 AI안전연구소가 안전성 평가 과정에 참여했을 뿐이다.